С развитием технологий искусственного интеллекта все чаще можно услышать о таком явлении как дипфейк. По сути это видео или аудио контент, сгенерированный нейросетями на базе реального изображения, видео или звука. В основе таких видеороликов – модель, которую стилизуют под определенного человека с помощью технологий машинного обучения. В итоге на видео можно увидеть политического деятеля, популярного актера, блогера или даже вашего знакомого. Сегодня эта разработка активно используется в разных сферах деятельности человека – творчестве, культуре, блоггинге, кинематографии, политике и даже в мошенничестве. Чтобы не пасть жертвой интернет-жуликов, важно уметь различать дипфейки от реальных людей, а также быть готовым ко встрече со злоумышленником и эффективно противостоять манипуляциям.

Безобидные сценарии использования дипфейков

Дипфейки достаточно реалистично копируют людей – мимика, черты лица и даже голос у многих не вызывает сомнений в подлинности контента. Такие цифровые разработки активно используют в кино: дипфейком можно заменить актера, с его помощью легко улучшить качество дубляжа кинофильма. А в рекламе использование сгенерированного искусственным интеллектом видео существенно экономит бюджет на съемку.

ЧИТАЙТЕ ТАКЖЕ: ТОП фраз, по которым можно вычислить телефонных мошенников

Еще один вариант применения подобных роликов на благо человечества – создание виртуальных прижизненных копий человека, которые остануться доступными после его смерти. Родственники и близкие в этом случае смогут поговорить с умершим, провести с ним время. Но эта разработка пока не реализована в полной мере в реальности, хотя ее и называют одним из самых перспективных векторов развития индустрии дипфейков.

Дипфейки и мошенничество

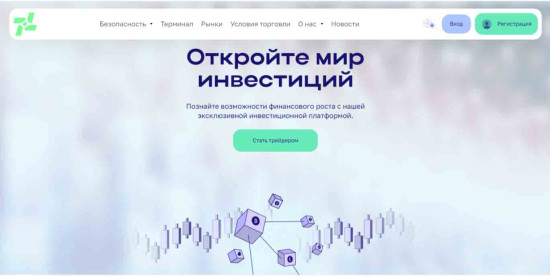

Использовать контент, сгенерированный нейросетями, мошенники научились сразу в нескольких направлениях своей деятельности. Самый распространенный вариант – использовать звезду или лидера мнений для влияния на его аудиторию. Например, злоумышленники выпускают видео, в котором блогер-миллионник призывает зарегистрироваться на определенной криптобирже или в пирамиде, чтобы зарабатывать миллионы. Те, кто не распознает подделку и попадется на удочку, теряют свои деньги в очередном скам-проекте. На скриншоте дипфейк с использованием лица Павла Воли.

Еще один вариант незаконного использования дипфейков – создание контента, призванного повлиять на настроения в обществе. Чаще всего это касается политической и социальной сферы жизни. В Сети есть немало фейковых видео, в которых якобы политические и военные деятели, социальные блогеры или знаменитые журналисты призывали к тем или иным действиям или транслировали несвойственные им тезисы.

Но наиболее распространенным вариантом использования нейросетей в обманных схемах стала генерация голосовых сообщений и имитация общения по видеосвязи от лица другого человека. Например, от вашего знакомого вы получаете текстовое сообщение с просьбой одолжить некоторую сумму, но вы не знаете, что аккаунт мессенджера или социальной сети человека уже взломан. И чтобы не вызывать лишних подозрений, мошенники вдогонку к этому сообщению, отправляют и голосовое сообщение, сгенерированное искусственным интеллектом. В них чаще всего голос получается действительно похожим, но интонации и качество речи могут вызвать подозрение.

Как распознать “подделку”

Несмотря на то, что дипфейки зачастую выглядят реалистично, найти в них изъяны и заподозрить неладное не так и сложно. На помощь потенциальной жертве придет соответствующее программное обеспечение, современные девайсы и здравый смысл.

Например, если вы с родственниками еженедельно созваниваетесь по видеосвязи, их внезапный видеозвонок скорее всего вас не смутит. Но если вы общались всегда “голосом”, а собеседник без предупреждения перешел на видео, это повод задуматься и проверить абонента на подлинность.

Важно соблюдать бдительность и тогда, когда, например, политический деятель рассказывает в своем видеообращении о чем-то, чего от него никто не ждал услышать или угасающая звезда 90-х делиться своим секретом о гарантированных способах заработка.

Все, что вас удивляет, обязательно нужно проверять. Это единственный вариант не попасться на удочку потенциальных мошенников. Ниже приведены доступные каждому способы распознать дипфейки.

Визуальные несоответствия и рассинхронизация

Итак, вы видите перед собой человека, который записывает ролик на камеру или разговаривает с вами онлайн, но ситуация вызывает у вас подозрения. В первую очередь оцените следующие моменты:

- равномерен ли цвет кожи на руках, теле и лице – в фейковых видео такие расхождения в оттенках считаются нормой;

- насколько часто герой видео моргает в кадре – слишком частое или редкое моргание указывает на использование нейросетей для создания ролика;

- смотрит ли человек исключительно в камеру, или он посматривает по сторонам – алгоритмы пока не умеют делать взгляд подвижным.

Рассинхронизация звуковой и видеодорожки также подскажет, что перед вами дипфейк. Если вы слышите речь, но губы человека не двигаются, или наоборот, в тишине вы заметили движения рта – это повод усомниться в подлинности контента.

Особенности звука в дипфейках

Общаясь по видеосвязи, слушая голосовое сообщение или изучая ролик в Сети, обратите внимание на аудио составляющую контента. Для живого человека свойственен определенный набор звуков, нейросеть же при создании дипфейка, игнорирует этот момент. Если вы заметите какие-то нехарактерные нотки в голосе или почувствуете неладно в дыхании, стоит сразу проверить видео на подлинность.

Для сгенерированного контента нормальным считается обрывчатый тембр голоса, отсутствие эмоциональной окраски в словах и дефицит звуковых акцентов на тех или иных тезисах. Также в этих роликах нередко “проглатываются” окончания слов или фраз.

Программное обеспечение для идентификации дипфейков

Современный софт для ПК или смартфонов также может помочь распознать подделку. Большинство подобных приложений также базируется на алгоритмах искусственного интеллекта и с большой долей вероятности распознает фейковые фото и видео. Самыми популярными разработками в этом направлении считаются:

- Forensically – программа для анализа визуального контента;

- Image Edited – бесплатное приложение для проверки изображений;

- Truepic – дает информацию о происхождении материала;

- Deepware – бесплатная программа, оценивающая реальность видео;

- KaiCatch – сервис обнаружения искажений на объектах.

Перечень подобного софта постоянно дополняется, в открытом доступе доступны для скачивания актуальные версии программ, которые помогут идентифицировать мошеннический контент.

Способы проверки подлинности в переписке или разговоре

В процессе беседы со знакомыми по видеосвязи, вычислить дипфейк очень легко – достаточно попросить человека повернуться к камере в профиль или провести рукой перед лицом. Настоящее видео при этом остается целостным, а если актер фейка повернется боком, картинка “поплывет” и черты лица резко потеряют форму. Поскольку нейросеть для создания видео использует ранее загруженные в интернет файлы, у нее недостаточно материалов для того, чтобы воспроизвести нужное лицо под углом, ведь фотографий лиц в профиль в Сети все еще очень мало.

Еще более надежный способ проверить, действительно ли перед вами реальный человек, закончить сеанс связи и перезвонить ему самостоятельно. Так вы будете абсолютно уверены, что общаетесь со своим знакомым или близким. А если есть необходимость убедиться, что перед вами реальный человек, так, чтобы он сам не заметил подвоха, спросите у него то, что известно лишь вам двоим, например, уточните какой-то факт из прошлого.

ЧИТАЙТЕ ТАКЖЕ: Bitpro Autotrade – новый жульнический проект от старых мошенников

Итоги

Технологии искусственного интеллекта развиваются очень стремительно, и, безусловно, мошенники уже поставили их на службу, поэтому с каждым годом шансов столкнуться с дипфейками становится больше не только у звезд и чиновников, но и у простых россиян.

Чтобы избежать финансовых потерь и не подставлять под удар своих друзей и близких, необходимо тщательно отслеживать новые тренды в мошеннической сфере и учиться своевременно их распознавать. Если критически воспринимать информацию и подвергать подозрительные явления сомнению и проверкам, шансов у преступников на ваши деньги просто не останется.